Ramón Salaverría, coordinador de IBERIFIER: “La inteligencia artificial no sustituirá al periodista, pero transformará la profesión para siempre”

El catedrático de Periodismo Ramón Salaverría coordina desde su creación el Observatorio Ibérico de Medios Digitales Iberifier, ahora en su segunda etapa como proyecto de investigación Iberifier Plus. Este hub, formado por universidades, fact-checkers y entidades como la Fundación Española para la Ciencia y la Tecnología o el Barcelona Supercomputing Center tiene como objetivo combatir la desinformación en un contexto en el que la tecnología juega un papel fundamental.

Ramón Salaverría, catedrático de Periodismo en la Universidad de Navarra, es uno de los referentes internacionales en la investigación del periodismo digital.

El investigador fue ponente en el Congreso Internacional FAKEPENAL, organizado en noviembre por el Centro Crímina de la Universidad Miguel Hernández, para abordar los riesgos de la comunicación y la desinformación en la era digital. Para el profesor de la Universidad de Navarra, la inteligencia artificial (IA) puede ayudar en la diseminación rápida y eficiente de información científica y especializada siempre que se haga desde unos parámetros éticos y responsables.

P. ¿Cuáles diría que son los avances más significativos que la IA ha aportado al periodismo?

R. Lo primero que debemos tener presente es que la IA no es una única tecnología, sino un conjunto de ellas. Por lo tanto, sus aportes no son únicos, sino múltiples. Aunque estas tecnologías llevan tiempo siendo utilizadas en el periodismo, han cobrado una mayor visibilidad pública recientemente, especialmente desde noviembre de 2022, cuando Open AI lanzó Chat GPT. Fue como un efecto de fuegos artificiales: de repente, la IA generativa parece haber eclipsado al resto de tecnologías dentro del sector, aunque es solo una de muchas áreas de desarrollo.

El trabajo periodístico puede estructurarse en tres fases principales: investigación, elaboración y distribución de contenidos. Las tecnologías de IA tienen impacto en cada una de estas fases.

P. ¿Cuál es el impacto específico en cada una de estas fases?

R. En la investigación, hay herramientas que permiten analizar patrones informativos o procesar imágenes y datos diversos, aunque su uso es menos conocido públicamente. En la elaboración, las tecnologías generativas, como las que crean texto, imágenes o sonido, han generado mucho interés. Estas herramientas están en fase experimental, pero poco a poco comienzan a incorporarse en las redacciones. En la distribución, es quizás donde más tiempo llevan siendo utilizadas. Las IA permiten segmentar audiencias, establecer patrones de consumo, hacer trazabilidad de contenidos y, en última instancia, facilitar la captación de suscriptores.

P. ¿Cuáles son los principales enemigos de la información científica?

R. Hay una serie de peligros comunes a cualquier disciplina, pero en la ciencia hay particularidades importantes. Uno de los problemas es su alta especialización, lo que implica terminología técnica y contenidos difíciles de entender para el público general. Esto hace que los ciudadanos sean más vulnerables a la desinformación. Si entiendes un tema, puedes identificar rápidamente una falsedad, pero en ciencia, ese desconocimiento deja mucho espacio para los errores.

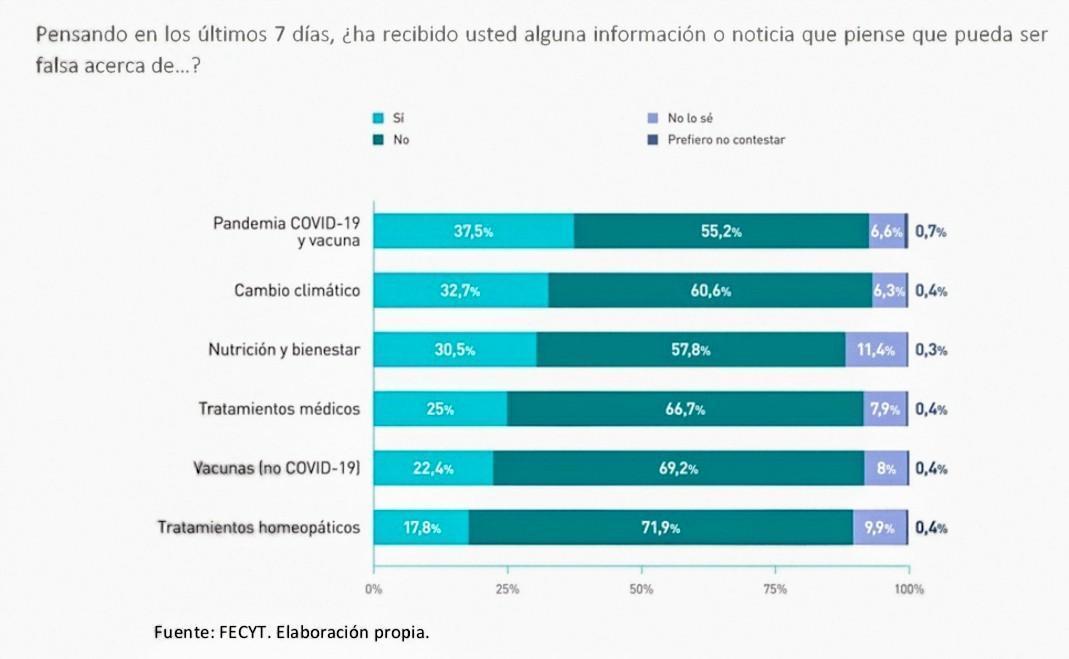

Fecyt. Informe Desinformación Científica en España 2022.

Otro aspecto es el tiempo. La ciencia de calidad requiere procesos lentos y meticulosos, mientras que el periodismo y la desinformación funcionan en ciclos acelerados. Esto aumenta la probabilidad de que se difundan contenidos no suficientemente fundamentados. Además, el periodismo a menudo no cuenta con la colaboración activa de los científicos, lo que deja espacio a pseudocientíficos o embaucadores para ocupar el ámbito público. Todo esto conspira contra la información científica de calidad.

P. ¿Cómo podemos asegurar un buen uso de la IA en este contexto?

R. Es una pregunta compleja. La IA generativa tiene cualidades que podrían ayudar en la diseminación rápida y eficiente de información científica. Por ejemplo, puede analizar grandes volúmenes de datos especializados y transformarlos en contenidos más comprensibles para periodistas o el público general.

Un modelo como Chat GPT puede interpretar artículos científicos y convertirlos en resúmenes accesibles, lo cual es una ventaja importante. Sin embargo, el buen uso de la IA requiere un enfoque ético y responsable, algo que todavía está en construcción.

Thinkers 360. Compañías líderes en IA

P. ¿Cuál es el papel de los medios en la prevención de la desinformación científica?

R. Los medios tienen un papel crucial, pero también enfrentan desafíos. Por un lado, son permeables al sensacionalismo, exagerando titulares que deberían presentarse de manera más rigurosa. Por otro lado, estamos viendo una desintermediación: ya no son los únicos canales para comunicar información científica, y esto da espacio a supuestos expertos o periodistas que difunden contenidos sesgados o incorrectos.

El periodismo necesita reforzar sus estándares y prácticas para competir con estas dinámicas y asegurar que la información que ofrecen sea rigurosa y accesible.

P. ¿Hasta qué punto es buena la personalización de los algoritmos en los medios de comunicación?

R. Los algoritmos tienen el potencial de generar cámaras de eco y polarización. Tienden a priorizar las afirmaciones extremas, mientras que las posturas moderadas quedan relegadas. En los medios, se están incorporando estas tecnologías para jerarquizar contenidos automáticamente, basándose en parámetros como el número de visitas. Sin embargo, si estos criterios son únicamente cuantitativos y no consideran la calidad o sensibilidad de la información, especialmente en temas como la ciencia, las leyes o la salud, los riesgos de diseminar información irresponsable aumentan exponencialmente.

P. ¿Cree que, si se ha utilizado IA en la producción y distribución de información, el lector debería saberlo?

R. Absolutamente. La transparencia es un valor esencial en el periodismo. Así como se indica cuando una noticia proviene de una agencia, debería informarse si un contenido ha sido generado total o parcialmente por inteligencia artificial. Incluso sería útil especificar qué herramientas o algoritmos se utilizaron.

Es algo que ya ocurre en otros contextos, como los artículos científicos, donde se detalla la contribución de cada autor. Aplicar este enfoque al periodismo permitiría a los lectores entender mejor el origen y proceso de la información.

P. Si Elon Musk utilizase la IA para desinformar, ¿cree que podría superar a la ciencia en influencia?

R. Tendemos a exagerar el impacto real de las redes sociales. Aunque estas tienen una incidencia significativa, sobre todo en círculos políticos y periodísticos, las sociedades son mucho más diversas. Ahora bien, si hablamos de un caso concreto como el de Elon Musk utilizando herramientas avanzadas de IA para desinformar, su capacidad de influencia sería grande, especialmente por el alcance y repercusión que tienen esas figuras en determinados sectores. Sin embargo, creo que no hay que caer en la tentación de sobredimensionar ese impacto como algo inevitable o insuperable.

Elon Musk Wikimedia Commons.

P. ¿Cómo visualiza el rol de los periodistas en un entorno cada vez más automatizado? ¿Qué habilidades considera esenciales para ellos?

R. En un contexto de transformación tecnológica, los periodistas deben estar actualizados. La IA puede generar ciertos contenidos de manera más rápida y eficiente, pero no sustituye habilidades humanas como la observación, la contextualización o el análisis crítico.

Los periodistas deben complementar su trabajo con la tecnología, en lugar de temerla. Esto implica identificar qué tareas pueden automatizarse y cuáles requieren intervención humana. El periodismo del futuro no será el mismo, pero seguirá siendo relevante si logra adaptarse y redefinir sus funciones.